提问/ 作为DBA运维的你是否有过这些苦恼

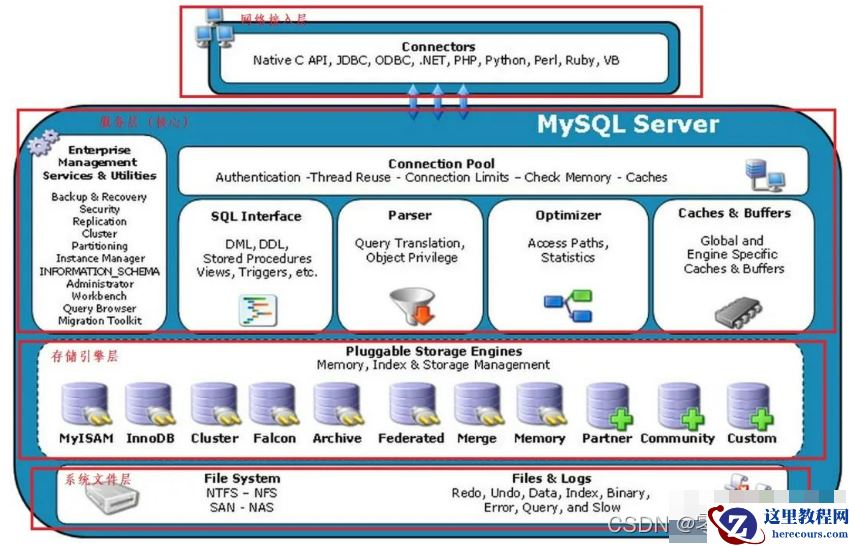

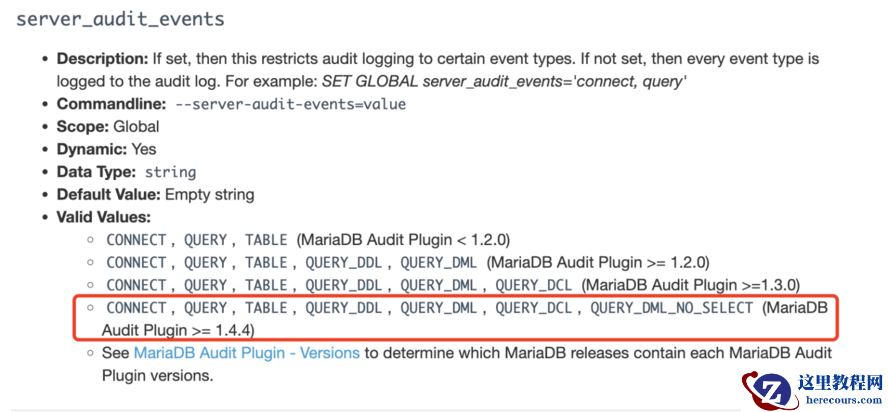

1) 什么?又有告警啦,CPU咋又飙高啦?IO又打满啦?对服务器赶紧一顿操作猛如虎,然并卵,故障犹如股市大盘,依然坚挺,还有客户、领导在后面排队督军,此时谁来help我呢?2)有时候出去面试, 明明感觉和面试官聊的很好,但面试完成后就没有后续,是否有过疑惑,这是why ? 面试官:请给出数据库实例所在的物理机上CPU飙高及IO飙高的故障排查思路。 应聘者:可以先查看当前系统的性能,然后在查看一下数据库的会话,一般都是慢日志导致的,针对慢sql优化进行话题展开。 面试者:如果io飙高确认不是慢sql导致的,该如何排查呢? 应聘者:啥?啥?啥?弄啥嘞?这该怎么回答,我也没遇到过啊,心中万只草泥马在奔腾。

相关推荐

-

雷神推出 MIX PRO II 迷你主机:基于 Ultra 200H,玻璃上盖 + ARGB 灯效

2 月 9 日消息,雷神 (THUNDEROBOT) 现已宣布推出基于英

-

制造商 Musnap 推出彩色墨水屏电纸书 Ocean C:支持手写笔、第三方安卓应用

2 月 10 日消息,制造商 Musnap 现已在海外推出一款 Oce