偏见检测不是 C# 内置能力,得靠外部模型或规则库

C# 本身不提供“检测算法偏见”的 API。它能读文件、切文本、调 HTTP,但判断某句话是否含性别/地域/年龄偏见,靠的是你集成的模型(比如 Hugging Face 的

roberta-base-finetuned-weat)或预定义规则(如关键词黑名单 + 上下文模式)。别指望

File.ReadAllText返回一个“偏见分”。

常见错误现象:

NullReferenceException出现在你直接对未初始化的

IBiasDetector接口调用

Detect();或者把英文偏见词表硬套在中文文本上,结果全报“低风险”——其实是完全没匹配。 中文场景必须用中文敏感词库或微调过的中文模型,英文模型对“女程序员=逻辑弱”这类隐性表达基本失效 若用规则法,别只查孤立词(如“老人”),要结合动词和评价词:匹配

"老人" + ("不适合"|"学不会"|"反应慢") 这类模式

性能上,正则多层嵌套 + 全文扫描在 10MB+ 文件里会明显卡顿,建议先按行读取,再用 Parallel.ForEach分块处理

用 HttpClient 调用轻量级开源 Bias API 最快落地

比自己训练模型现实得多:找已部署的开源服务,比如

bias-detector-api(Python Flask 实现,支持 POST JSON 文本),C# 只需发请求、解析响应。这是中小项目两周内能上线的路径。

使用场景:日志分析系统导出的用户反馈 CSV,每行一条评论,需标记“潜在偏见强度”。不用改现有 .NET 架构,加个定时任务轮询新文件即可。

请求体必须是 UTF-8 编码,否则中文变???;

HttpClient默认用系统编码,显式设

StringContent(..., Encoding.UTF8, "application/json")API 响应字段名要核对清楚,比如返回

{"bias_score": 0.82, "trigger_terms": ["保姆", "阿姨"]},别错写成 score或

biased_terms超时必须设,别用默认的 100 秒——远程 API 卡住会导致整个文件解析线程挂起;

new TimeSpan(0, 0, 5)更稳妥

本地规则引擎需避开“同音字绕过”和“反讽误判”

纯规则方案适合可控环境(如内部工单系统),但容易被语言灵活性打穿。比如“这个需求真‘优秀’啊”带反讽,规则若只看褒义词“优秀”,就会漏判;又比如用“老”指代“资深”,却被当成年龄歧视。

参数差异:用

RegexOptions.IgnoreCase是基础,但必须加

RegexOptions.CultureInvariant,否则中文正则在某些区域设置下匹配失败。 触发词要分层级:核心词(如“残疾人不能”)直接标高危;修饰词(如“稍微”“好像”)降权,用系数乘以基础分 禁用模糊匹配

.*老人.*,改用带边界的

\b老人\b,避免“张老人”“老人头”误中 反讽识别可加简单启发式:检查褒义词前是否有否定词(“不”“没”“真”“太”)或标点(叹号、问号),但别过度——这已是规则法的复杂边界

文件编码和换行符不统一,会让所有检测逻辑失效

很多真实文本文件来自不同系统:Windows 记事本存的

GBK,Linux 日志是

UTF-8 with BOM,Mac 导出 CSV 用

\r换行。C# 默认用

Encoding.Default读,结果中文变乱码,关键词全匹配不上。

性能影响:用

StreamReader不指定编码时,它会逐字节试探 BOM,小文件无感,大文件开销翻倍;而错读编码后,后续所有字符串操作都在垃圾数据上跑。 优先用

File.ReadLines(path, Encoding.UTF8),强制 UTF-8;若不确定,先用

Ude.CharsetDetector库自动识别编码 换行符统一用

Environment.NewLine替换,别信

string.Split('\n') ——Windows 文件里可能是 \r\n,Linux 是

\n,拆出来空行一堆 读取前先

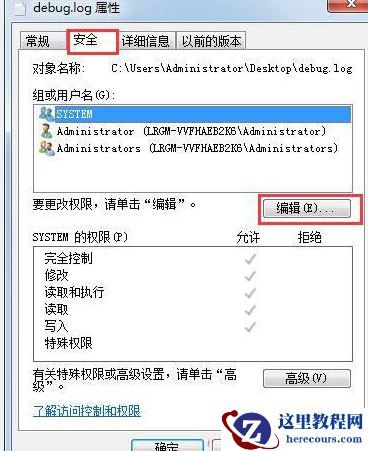

File.GetAttributes(path)检查是否为

ReadOnly,避免检测中途因权限失败,日志里只看到

UnauthorizedAccessException却不知哪行出问题

偏见检测真正的难点不在代码怎么写,而在“什么算偏见”的业务定义是否和法务、产品对齐。同一段话,合规团队说要拦截,算法团队说置信度不够,这时候代码再健壮也没用。