在MySQL实际开发中,“大表查询慢”是最常见、最头疼的性能问题——单表数据量超过2000万行、数据文件超过10GB后,即使加了索引,查询性能依然会急剧下降,P99响应时间从10ms飙升到500ms以上,甚至出现超时。

大表查询慢的核心原因,本质是单库单表突破了InnoDB的最优阈值:B+树树高增加、索引体积膨胀、Buffer Pool缓存命中率下降、全表扫描代价过高。本文将从索引优化、SQL优化、架构优化、配置优化四个维度出发,结合可复现的实战SQL、原理分析、避坑指南,给出一套全链路的大表查询优化方案,帮你把性能提升100倍以上。

前置认知:先搞懂什么是“MySQL大表”,以及为什么慢

1.1 什么是MySQL大表

行业内有几个通用的经验值(不是绝对的,要根据硬件、查询模式、行大小调整):

1.2 大表查询慢的核心原因

要优化大表查询,必须先搞懂为什么慢:

B+树树高增加:单表数据量越大,B+树的树高就越高,查询需要的磁盘IO次数就越多(磁盘IO的性能是内存操作的十万倍级别);索引体积膨胀:索引体积太大,会占用大量的Buffer Pool内存,导致缓存命中率从99%下降到80%以下,磁盘IO大幅增加;全表扫描代价过高:大表全表扫描需要读取数GB的数据,耗时数分钟甚至数小时,完全无法接受;回表次数增加:如果没有覆盖索引,查询需要多次回表,每次回表都是一次磁盘IO,性能急剧下降。一、索引优化:成本最低、效果最好的核心方案

索引优化是大表查询优化的第一选择——成本最低、效果最好,通常能把性能提升10~100倍,不需要修改业务代码,不需要调整架构。

1.1 优先使用覆盖索引,避免回表

原理分析

回表是大表查询慢的重要原因:

普通索引的叶子节点只存储索引键值和主键值,不存储完整行数据;如果查询的字段不在索引中,需要拿着主键值到聚簇索引中再次查询(回表),每次回表都是一次磁盘IO;覆盖索引是指索引中包含了查询需要的所有字段,不需要回表,直接从索引中就能拿到所有数据,性能提升数倍。实战示例

假设你有一个电商订单表,结构如下:

CREATE TABLE order_info ( id BIGINT NOT NULL AUTO_INCREMENT PRIMARY KEY, user_id BIGINT NOT NULL COMMENT '用户ID', order_no VARCHAR(32) NOT NULL COMMENT '订单号', amount DECIMAL(10,2) NOT NULL COMMENT '订单金额', status TINYINT NOT NULL COMMENT '订单状态', create_time DATETIME NOT NULL COMMENT '创建时间', INDEX idx_user_id (user_id) ) ENGINE=InnoDB DEFAULT CHARSET=utf8mb4;

优化前:查询用户的订单列表,需要回表

-- 优化前:查询用户的订单列表,需要回表 EXPLAIN SELECT id, order_no, amount, status, create_time FROM order_info WHERE user_id = 1001;

EXPLAIN结果:

说明:用到了idx_user_id,但需要回表查询order_no、amount等字段。

优化后:创建覆盖索引,不需要回表

-- 优化后:创建覆盖索引,包含查询需要的所有字段 CREATE INDEX idx_user_id_cover ON order_info(user_id, order_no, amount, status, create_time); -- 再次查询,不需要回表 EXPLAIN SELECT id, order_no, amount, status, create_time FROM order_info WHERE user_id = 1001;

EXPLAIN结果:

说明:Extra有Using index,说明用到了覆盖索引,不需要回表,性能提升数倍。

避坑指南

覆盖索引不是“把所有字段都加进去”:索引字段太多会导致索引体积膨胀,Buffer Pool缓存命中率下降,反而影响性能;只把查询需要的字段加进去:根据业务的高频查询场景,设计对应的覆盖索引;联合索引的顺序要合理:把最常用的等值查询列放在最左边,遵循最左前缀原则。1.2 合理设计联合索引,遵循最左前缀原则

原理分析

联合索引的B+树是按最左列排序,左列相同按中间列排序,左中都相同按右列排序的:

必须从最左列开始匹配,且不能跳过中间列,才能完整利用索引的有序性;合理的联合索引设计,能让80%的高频查询都用上索引,性能大幅提升。实战示例

还是刚才的订单表,业务有以下3个高频查询:

SELECT * FROM order_info WHERE user_id = ?SELECT * FROM order_info WHERE user_id = ? AND create_time >= ?SELECT * FROM order_info WHERE user_id = ? AND status = ?

优化前:只有idx_user_id,后面两个查询只能用到user_id,create_time和status无法利用有序性

-- 优化前:只有idx_user_id EXPLAIN SELECT * FROM order_info WHERE user_id = 1001 AND create_time >= '2026-01-01';

EXPLAIN结果:

说明:只能用到user_id(key_len=8),create_time通过索引下推过滤,无法利用有序性。

优化后:设计合理的联合索引

-- 优化后:设计两个联合索引,覆盖3个高频查询 CREATE INDEX idx_user_id_create_time ON order_info(user_id, create_time); CREATE INDEX idx_user_id_status ON order_info(user_id, status); -- 再次查询,能完整利用索引的有序性 EXPLAIN SELECT * FROM order_info WHERE user_id = 1001 AND create_time >= '2026-01-01';

EXPLAIN结果:

说明:能用到user_id和create_time(key_len=13),完整利用索引的有序性,性能大幅提升。

避坑指南

联合索引的列数不宜过多:通常不超过5个,列数太多会导致索引体积膨胀;把最常用的等值查询列放在最左边:保证最左前缀的利用率最高;范围查询列尽量靠后:避免范围查询阻断后面列的有序性利用。1.3 对长字符串列使用前缀索引

原理分析

如果索引列是长字符串(比如VARCHAR(255)、TEXT),直接建索引会导致索引体积膨胀,Buffer Pool缓存命中率下降:

实战示例

假设你有一个用户表,username列是VARCHAR(64),需要建索引:

CREATE TABLE user_info ( id BIGINT NOT NULL AUTO_INCREMENT PRIMARY KEY, username VARCHAR(64) NOT NULL COMMENT '用户名', phone VARCHAR(16) NOT NULL COMMENT '手机号', INDEX idx_username (username(16)) -- 前缀索引,取前16个字符 ) ENGINE=InnoDB DEFAULT CHARSET=utf8mb4;

如何选择合理的前缀长度?

可以通过以下SQL计算区分度,选择区分度接近完整索引的最短前缀:

-- 计算完整索引的区分度 SELECT COUNT(DISTINCT username) / COUNT(*) AS full_cardinality FROM user_info; -- 计算前缀长度为8的区分度 SELECT COUNT(DISTINCT LEFT(username, 8)) / COUNT(*) AS prefix_8_cardinality FROM user_info; -- 计算前缀长度为16的区分度 SELECT COUNT(DISTINCT LEFT(username, 16)) / COUNT(*) AS prefix_16_cardinality FROM user_info;

选择区分度接近full_cardinality的最短前缀,比如prefix_16_cardinality接近full_cardinality,就选16作为前缀长度。

避坑指南

- 前缀索引无法用于覆盖索引:因为前缀索引只存储了前N个字符,无法覆盖完整的查询字段;前缀索引无法用于ORDER BY/GROUP BY:因为前缀索引的有序性不完整;如果区分度太低,不要用前缀索引:比如

username的前8个字符都是“user_”,区分度太低,不如用完整索引。1.4 定期清理无用、重复、失效的索引

原理分析

索引不是越多越好:

每个索引都需要占用磁盘空间,索引体积膨胀会导致Buffer Pool缓存命中率下降;每次INSERT/UPDATE/DELETE都需要维护所有索引,写入性能会大幅下降;无用、重复、失效的索引,只会浪费资源,不会提升性能。如何查找无用、重复、失效的索引?

可以通过以下SQL查找:

-- 查找未使用的索引(MySQL 5.6+) SELECT OBJECT_SCHEMA AS database_name, OBJECT_NAME AS table_name, INDEX_NAME AS index_name FROM performance_schema.table_io_waits_summary_by_index_usage WHERE INDEX_NAME NOT IN ('PRIMARY') AND COUNT_STAR = 0 AND OBJECT_SCHEMA NOT IN ('mysql', 'information_schema', 'performance_schema'); -- 查找重复的索引(比如有idx_a,又有idx_a_b) SELECT database_name, table_name, redundant_index_name, dominant_index_name FROM sys.schema_redundant_indexes;

实战示例

找到无用、重复的索引后,直接删除:

-- 删除无用的索引 DROP INDEX idx_unused ON order_info; -- 删除重复的索引 DROP INDEX idx_a_b ON order_info;

避坑指南

- 删除索引前要确认:可以先把索引设置为不可见(MySQL 8.0+),观察一段时间,确认没有影响后再删除;不要删除主键索引:主键索引是聚簇索引,删除后会导致表结构重建,非常危险;定期清理:建议每3-6个月清理一次无用、重复的索引。

1.5 用EXPLAIN验证索引是否生效

原理分析

EXPLAIN是验证索引是否生效的唯一工具,重点关注这4个字段:

实战示例

-- 用EXPLAIN验证查询 EXPLAIN SELECT id, order_no, amount, status, create_time FROM order_info WHERE user_id = 1001 AND create_time >= '2026-01-01';

二、SQL优化:改写烂SQL,性能提升100倍

很多时候大表查询慢,不是因为索引设计不好,而是因为SQL写得太烂——比如SELECT *、子查询嵌套太深、ORDER BY/GROUP BY没有索引等。改写烂SQL,通常能把性能提升10~100倍,不需要修改索引,不需要调整架构。

2.1 避免SELECT *,只查需要的字段

原理分析

SELECT *的危害:

- 增加回表次数:如果没有覆盖索引,SELECT *需要回表查询所有字段,每次回表都是一次磁盘IO;增加网络传输开销:查询不需要的字段,会增加网络传输的数据量,尤其是大字段(TEXT、BLOB);无法利用覆盖索引:SELECT *需要所有字段,很难设计对应的覆盖索引。

实战示例

优化前:SELECT *,需要回表

-- 优化前:SELECT *,需要回表 SELECT * FROM order_info WHERE user_id = 1001;

优化后:只查需要的字段,能利用覆盖索引

-- 优化后:只查需要的字段 SELECT id, order_no, amount, status, create_time FROM order_info WHERE user_id = 1001;

2.2 避免全表扫描,让WHERE条件用上索引

原理分析

全表扫描是大表查询慢的“头号杀手”:

大表全表扫描需要读取数GB的数据,耗时数分钟甚至数小时;必须让WHERE条件用上索引,避免全表扫描。常见的导致全表扫描的原因

- WHERE条件中没有索引列;索引失效(违反最左前缀、用函数/表达式、隐式类型转换、LIKE通配符在开头等);优化器选错执行计划(统计信息过期、索引区分度太低等)。

实战示例

优化前:WHERE条件中用了函数,索引失效,全表扫描

-- 优化前:用了YEAR()函数,索引失效 EXPLAIN SELECT * FROM order_info WHERE YEAR(create_time) = 2025;

EXPLAIN结果:

优化后:用范围查询替代函数,索引生效

-- 优化后:用范围查询替代YEAR()函数 EXPLAIN SELECT * FROM order_info WHERE create_time >= '2025-01-01 00:00:00' AND create_time < '2026-01-01 00:00:00';

EXPLAIN结果:

2.3 用JOIN替代子查询,避免嵌套太深

原理分析

子查询嵌套太深的危害:

- MySQL优化器对子查询的优化能力有限:嵌套太深的子查询,优化器可能无法优化,导致全表扫描;执行效率低:嵌套子查询通常需要多次扫描表,执行效率低;可读性差:嵌套太深的子查询,可读性差,难以维护。

实战示例

优化前:子查询嵌套太深

-- 优化前:子查询嵌套太深 SELECT * FROM order_info WHERE user_id IN ( SELECT id FROM user_info WHERE city IN ( SELECT id FROM city WHERE province = '湖北省' ) );

优化后:用JOIN替代子查询

-- 优化后:用JOIN替代子查询 SELECT o.* FROM order_info o JOIN user_info u ON o.user_id = u.id JOIN city c ON u.city = c.id WHERE c.province = '湖北省';

2.4 优化ORDER BY/GROUP BY,避免文件排序和临时表

原理分析

Using filesort(文件排序)和Using temporary(临时表)是大表查询慢的重要原因:

实战示例

优化前:ORDER BY没有索引,文件排序

-- 优化前:ORDER BY create_time没有索引,文件排序 EXPLAIN SELECT * FROM order_info WHERE user_id = 1001 ORDER BY create_time DESC;

EXPLAIN结果:

优化后:创建联合索引,避免文件排序

-- 优化后:创建联合索引(user_id, create_time) CREATE INDEX idx_user_id_create_time ON order_info(user_id, create_time); -- 再次查询,避免文件排序 EXPLAIN SELECT * FROM order_info WHERE user_id = 1001 ORDER BY create_time DESC;

EXPLAIN结果:

2.5 用LIMIT分页,避免扫描大量数据

原理分析

大表分页查询慢的核心原因是LIMIT 大偏移量, 行数:

实战示例

优化前:LIMIT 1000000, 10,扫描1000010行数据

-- 优化前:LIMIT 1000000, 10,扫描1000010行数据 SELECT * FROM order_info ORDER BY id DESC LIMIT 1000000, 10;

优化后:用主键覆盖的延迟关联法,只扫描10行数据

-- 优化后:用主键覆盖的延迟关联法 SELECT o.* FROM order_info o JOIN ( SELECT id FROM order_info ORDER BY id DESC LIMIT 1000000, 10 ) tmp ON o.id = tmp.id;

2.6 批量操作替代单条操作,减少交互次数

原理分析

单条操作的危害:

每次操作都需要建立连接、发送SQL、执行SQL、关闭连接,交互次数多,性能差;每次操作都需要维护索引,写入性能差;批量操作能大幅减少交互次数,性能提升10~100倍。实战示例

优化前:单条INSERT,1000次操作

-- 优化前:单条INSERT,1000次操作 INSERT INTO order_info (user_id, order_no, amount, status, create_time) VALUES (1001, 'order_1', 100.00, 1, NOW()); INSERT INTO order_info (user_id, order_no, amount, status, create_time) VALUES (1001, 'order_2', 200.00, 1, NOW()); -- ... 重复1000次

优化后:批量INSERT,1次操作

-- 优化后:批量INSERT,1次操作 INSERT INTO order_info (user_id, order_no, amount, status, create_time) VALUES (1001, 'order_1', 100.00, 1, NOW()), (1001, 'order_2', 200.00, 1, NOW()), -- ... 1000条 (1001, 'order_1000', 100000.00, 1, NOW());

三、架构优化:突破单库单表的硬件限制

如果索引优化和SQL优化都试过了,性能依然无法满足业务需求,就需要考虑架构优化——突破单库单表的硬件限制,分散性能和存储压力。

3.1 读写分离:分散读压力

原理分析

很多业务场景都是“读多写少”:

读压力占90%,写压力占10%;读写分离能把读压力分散到多个从库,主库只承接写压力,性能大幅提升。实战架构

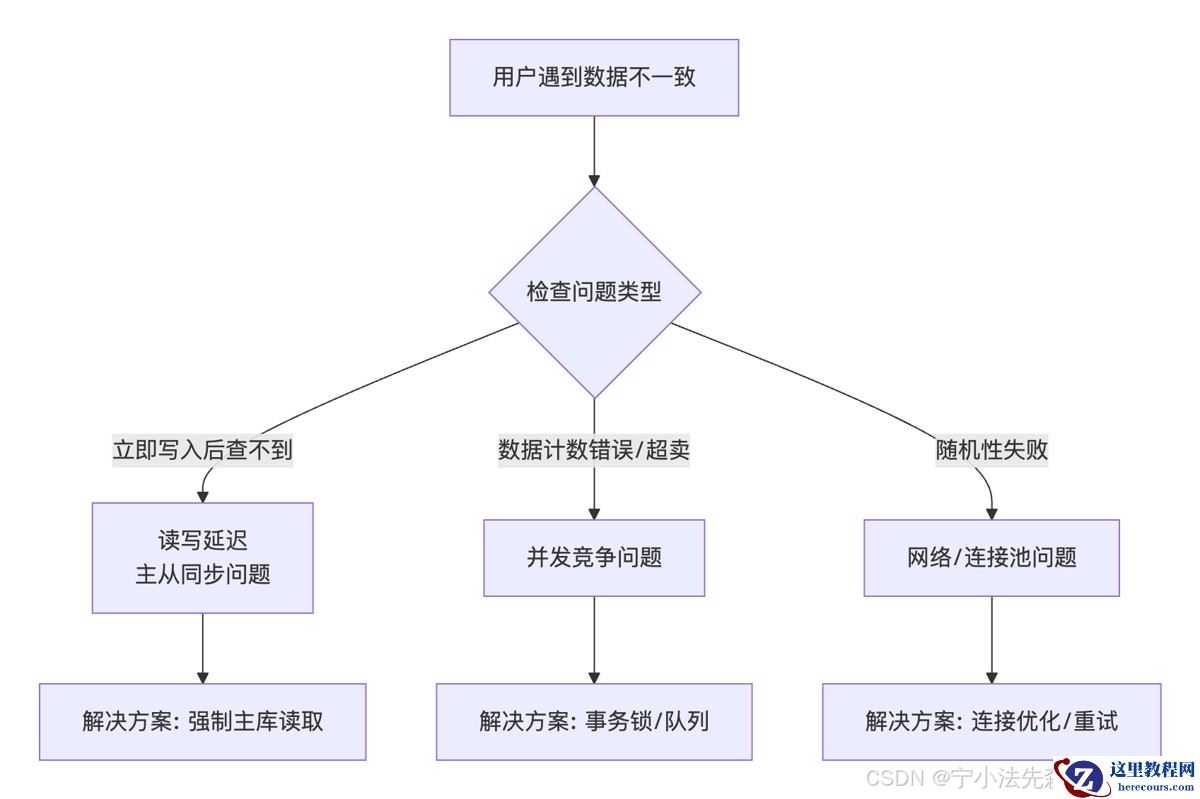

一主多从:1个主库,3个从库;写请求:走主库;读请求:均匀分散到3个从库;中间件:用ShardingSphere、MyCat等分库分表中间件,或者用ProxySQL、MaxScale等数据库代理,自动路由读写请求。避坑指南

主从延迟问题:读写分离会导致主从延迟,读请求可能读到旧数据; 解决方案:对数据一致性要求高的读请求,走主库;对数据一致性要求不高的读请求,走从库;从库数量不宜过多:通常不超过5个,从库数量太多会导致主从复制延迟增加;监控主从延迟:定期监控主从延迟,延迟过高时及时处理。3.2 冷热数据分离:减少热数据量

原理分析

大表中大部分数据是“冷数据”:

比如1年前的历史订单、历史流水,查询频率很低,但依然占用大量存储空间;冷热数据分离能把冷数据归档到历史库、对象存储(OSS/S3)或者数据仓库(Hive、ClickHouse),热数据保留在主库,大幅减少主库的数据量,性能大幅提升。实战方案

- 定义冷热数据:比如近3个月的订单为热数据,3个月前的为冷数据;自动归档:通过定时任务,每天把超过3个月的冷数据,自动从主库归档到历史库;查询路由:业务查询时,自动判断是热数据还是冷数据,路由到对应的存储;冷数据查询:冷数据的低频查询,从历史库或数据仓库查询。

避坑指南

- 归档前要备份:归档冷数据前,要先备份,避免数据丢失;查询路由要准确:避免把热数据路由到冷存储,影响性能;冷数据要压缩:冷数据可以压缩存储,节省空间。

3.3 分库分表:终极方案,但要谨慎

原理分析

如果单库单表的数据量超过1亿行,或者写压力超过硬件极限,就需要考虑分库分表:

把原本存储在单个数据库、单个数据表中的数据,按照一定的规则(分片键),分散存储到多个数据库、多个数据表中;突破单库单表的硬件限制,性能和存储都能水平扩展。实战方案

- 分片键选择:选择高基数、高频查询的字段作为分片键(比如user_id);分片规则:用范围分片、哈希分片或者一致性哈希分片;中间件:用ShardingSphere、MyCat等成熟的分库分表中间件;数据迁移:用中间件的数据迁移功能,把旧数据迁移到分库分表中。

避坑指南

- 分库分表是“终极手段”:只有当其他优化方案都试过无效时,才考虑分库分表;分片键选择要谨慎:分片键一旦选定,很难修改,要结合业务的长期增长规划;避免跨库查询:跨库查询的性能很差,要尽量避免;团队要有分库分表的运维能力:分库分表会增加系统复杂度,需要专业的运维能力。

四、存储引擎与配置优化:细节决定成败

4.1 选择合适的存储引擎(InnoDB是唯一选择)

原理分析

MySQL有多种存储引擎,但InnoDB是大表的唯一选择:

实战示例

-- 建表时指定InnoDB存储引擎 CREATE TABLE order_info ( id BIGINT NOT NULL AUTO_INCREMENT PRIMARY KEY, user_id BIGINT NOT NULL, order_no VARCHAR(32) NOT NULL, amount DECIMAL(10,2) NOT NULL, status TINYINT NOT NULL, create_time DATETIME NOT NULL, INDEX idx_user_id (user_id) ) ENGINE=InnoDB DEFAULT CHARSET=utf8mb4 ROW_FORMAT=DYNAMIC;

4.2 优化InnoDB Buffer Pool

原理分析

InnoDB Buffer Pool是InnoDB最重要的内存缓存:

用于缓存索引页和数据页,减少磁盘IO;Buffer Pool越大,缓存命中率越高,磁盘IO越少,性能越好;通常设置为服务器内存的50%~75%(如果服务器只跑MySQL)。配置示例(my.cnf/my.ini)

[mysqld] # Buffer Pool大小,设置为服务器内存的50%~75%,比如服务器内存16G,设置为10G innodb_buffer_pool_size = 10G # Buffer Pool实例数,通常设置为CPU核心数,比如8核CPU,设置为8 innodb_buffer_pool_instances = 8

4.3 优化redo log、undo log、binlog

原理分析

redo log、undo log、binlog是MySQL的三大日志:

redo log:用于崩溃恢复,保证事务的持久性;undo log:用于回滚事务,保证事务的原子性;binlog:用于主从复制和数据恢复。配置示例(my.cnf/my.ini)

[mysqld] # redo log文件大小,通常设置为1G~4G innodb_log_file_size = 2G # redo log文件数量,通常设置为2 innodb_log_files_in_group = 2 # binlog格式,设置为ROW,最安全 binlog_format = ROW # binlog过期时间,设置为7天 expire_logs_days = 7

4.4 优化连接数、排序缓存等参数

配置示例(my.cnf/my.ini)

[mysqld] # 最大连接数,通常设置为500~2000 max_connections = 1000 # 排序缓存大小,通常设置为256K~1M sort_buffer_size = 512K # 临时表大小,通常设置为32M~64M tmp_table_size = 64M max_heap_table_size = 64M

五、避坑指南:这5个错误不要犯

5.1 不要盲目加索引,索引不是越多越好

每个索引都需要占用磁盘空间,每次写入都需要维护所有索引;索引数量通常不超过表字段数的30%;定期清理无用、重复的索引。5.2 不要一开始就分库分表,避免过度设计

分库分表会增加系统复杂度,影响业务迭代速度;只有当其他优化方案都试过无效时,才考虑分库分表;早期业务优先考虑快速迭代,不要过度设计。5.3 不要忽略统计信息,定期更新

统计信息过期会导致优化器选错执行计划;表数据变化超过10%时,执行ANALYZE TABLE table_name更新统计信息;大促前,给核心表更新统计信息。

5.4 不要用SELECT *,只查需要的字段

SELECT *会增加回表次数,增加网络传输开销;只查需要的字段,能利用覆盖索引,性能大幅提升。5.5 不要忽略监控,定期分析慢SQL

开启慢查询日志,设置慢查询阈值为100ms;定期用pt-query-digest等工具分析慢SQL;监控Buffer Pool缓存命中率、主从延迟、CPU/内存/磁盘IO等指标。六、总结:大表查询优化的顺序和核心原则

最后,我们用一句话总结核心观点:

大表查询优化的顺序是:先索引优化,再SQL优化,再架构优化,最后配置优化——不要一开始就分库分表,避免过度设计。

核心原则回顾:

索引优化是第一选择:成本最低、效果最好,通常能把性能提升10~100倍;SQL优化是重要补充:改写烂SQL,通常能把性能提升10~100倍;架构优化是终极手段:只有当其他优化方案都试过无效时,才考虑;配置优化是细节补充:调整Buffer Pool、日志等参数,能进一步提升性能;监控是保障:定期分析慢SQL,监控核心指标,及时发现问题。永远记住:架构设计的核心是“适合业务”,而不是“技术先进”——要根据业务的实际情况,选择合适的优化方案,不要为了技术而技术。

以上就是从索引到架构的MySQL大表查询优化实战指南的详细内容,更多关于MySQL大表查询的资料请关注其它相关文章!