C# 做语音识别,关键不在“能不能”,而在“用什么场景、要什么效果、连不联网”——选错方案,轻则识别不准、中文崩盘,重则部署失败、麦克风静音。

用 System.Speech.Recognition

快速跑通离线命令识别

这是 .NET Framework 自带的本地引擎,不用联网、不依赖云密钥,适合做“打开/关闭/播放”这类固定指令识别,但对自由说话、长句、口音、背景噪音容忍度极低。

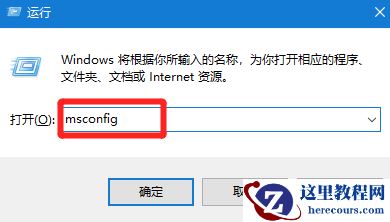

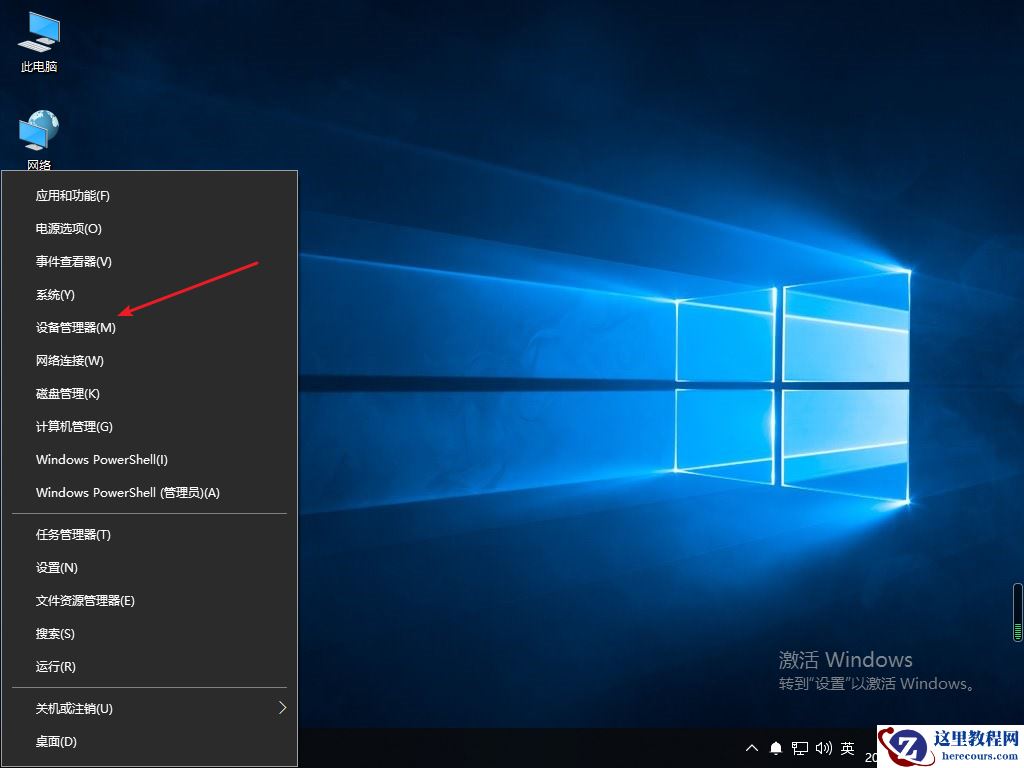

必须用.NET Framework 4.7.2+(不是 .NET Core / .NET 5+),否则

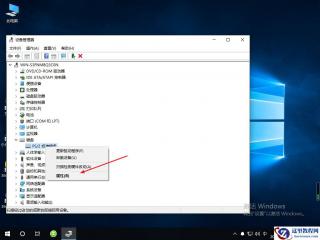

SpeechRecognitionEngine类根本不存在 系统得装对应语言的语音识别语言包(例如中文需安装“中文(简体)语音识别语言包”,Windows 设置 → 时间和语言 → 语音 → 下载语言) 语法必须预定义:

Choices只支持有限词表,不能直接识别任意句子;想识别自由文本,得用

DictationGrammar(),但准确率断崖式下降 麦克风权限默认不弹窗,若识别无声,先检查 Windows 隐私设置 → 麦克风 → 允许此设备的应用访问麦克风

using System.Speech.Recognition;

using System;

<p>var recognizer = new SpeechRecognitionEngine();

recognizer.SetInputToDefaultAudioDevice();

recognizer.LoadGrammar(new DictationGrammar()); // 注意:非命令模式,精度差

recognizer.SpeechRecognized += (s, e) => Console.WriteLine($"听到了:{e.Result.Text}");

recognizer.RecognizeAsync(RecognizeMode.Multiple);

Console.ReadLine();用 Microsoft.CognitiveServices.Speech SDK

实现高精度在线识别

这是微软官方推荐的现代方案,支持实时流式识别、多语种、标点自动恢复、说话人分离,但必须联网 + Azure 订阅密钥 + 正确区域配置,否则会卡在

Connection failed或报错

Invalid region。 NuGet 安装:

Microsoft.CognitiveServices.Speech(注意不是过时的

Microsoft.Bing.Speech)

SpeechConfig.FromEndpoint()中的 URL 格式必须是

https://<region>.stt.speech.microsoft.com/...</region>,常见错误是把 LUIS 或 TTS 的 endpoint 粘过来 中文识别需显式设置语言:

speechConfig.SpeechRecognitionLanguage = "zh-CN",否则默认英文,中文输入全变乱码或空结果 麦克风识别必须用

AudioConfig.FromDefaultMicrophoneInput(),别手误写成

FromFileInput—— 那是读文件,不是听你说话

var speechConfig = SpeechConfig.FromSubscription("your-key", "eastasia");

speechConfig.SpeechRecognitionLanguage = "zh-CN";

using var audioConfig = AudioConfig.FromDefaultMicrophoneInput();

using var recognizer = new SpeechRecognizer(speechConfig, audioConfig);

<p>Console.WriteLine("请说话...");

var result = await recognizer.RecognizeOnceAsync();

Console.WriteLine($"识别结果:{result.Text}");用 Whisper.Net

做真正离线、高鲁棒性的中文识别

如果你需要离线、能听清带口音/轻微噪音的日常对话(比如会议录音转文字),又不想被 Azure 配额或网络限制卡住,

Whisper.Net是目前 C# 生态里最靠谱的选择——但它不是“装完 NuGet 就能用”,模型文件得手动下载,路径一错就抛

FileNotFoundException。 必须同时安装两个 NuGet 包:

Whisper.net和对应平台的

Whisper.net.Runtime(如

Whisper.net.Runtime.Windows.x64) 模型文件(如

ggml-base-zh.bin)需从 Whisper.Net GitHub Releases 下载,放在项目输出目录(

bin/Debug),并确保

new WhisperFactory().CreateBuilder().WithModelPath(...)指向正确路径 它不直接支持麦克风实时流,得用

NAudio录一段 WAV 再喂给识别器;采样率必须为 16kHz 单声道,否则报错

Unsupported audio format首次加载模型慢(几百 MB 模型加载需数秒),别在 UI 线程直接 new,容易假死

别踩这些真实发生过的坑

很多“识别没反应”问题,其实跟语音算法无关,而是环境或权限链断裂:

SpeechRecognitionEngine报

InvalidOperationException: No recognizer of the required ID found→ 系统没装语言包,或装了但没设为默认输入语言

SpeechRecognizer一直卡在

Recognizing状态不回调 → 麦克风被其他程序独占(如 Teams、Zoom),或 Windows 音频服务崩溃(可重启

Windows Audio服务) Whisper.Net 加载模型后识别全是乱码或空字符串 → 模型文件损坏,或用了英文模型(

ggml-base.en.bin)强行识中文 腾讯云/百度 API 返回

invalid voice format→ 音频不是 16k/16bit/单声道,或 Base64 编码时丢了换行符(要用

Convert.ToBase64String(bytes, Base64FormattingOptions.None))

真正的难点从来不是写那几行识别代码,而是搞清楚你到底要让程序“听懂命令”还是“听懂人话”,再据此锁死运行环境、语言包、音频链路和错误处理边界——漏掉其中一环,整套流程就静音。